ゆうま

ゆうまえっ…この声、本当に家族なの?

先日、知人からこんな話を聞きました。「お母さんから急に電話がきて、『事故を起こした、すぐお金が必要』って言うから慌てて振り込んだら、本人は何も知らなくて」と。

声も話し方も、そっくりだったそうです。

AI技術の進化で、家族の声を数秒のデータから再現できるようになっています。オレオレ詐欺が「声が似てる」レベルだったとしたら、今起きているのは「本人と区別がつかない」レベルの話。しかも特別な技術者じゃなくても使えるツールが、もう出回っているんです。

特に高齢のご家族がいる方は、今日この記事を読んでほしいと思っています。

このページでは、なぜ今この手口が急増しているのか、ディープフェイクとの違い、実際の被害パターン、そして怪しい電話に気づくための具体的なチェックポイントを順番に説明していきます。国民生活センターや警察庁の情報もあわせて紹介しているので、難しい話が苦手な方でも読み進めやすいと思います。

読み終わったとき、「そういえば家族とこういう話、したことなかったな」と思ったら、ぜひそのまま連絡してみてください。

しろ

しろ技術で対抗するのは大変ですが、アナログな対策は意外と強力です。

実は私も、離れた両親とは「ペットの名前」を混ぜた合言葉を決めています。

どんなにAIが進化しても、家族にしか通じない「あの時の話」は再現できません。

肩肘張らず、夕飯の献立を聞くような気軽さで、対策を始めてみませんか。

- AI音声を使った詐欺の仕組みと具体的な手口

- なぜ今AI声詐欺が増えているのかという背景

- 高齢者や家族が狙われる理由と注意点

- 被害を防ぐための対策や相談先の情報

AIによる声の詐欺が急増する理由とは

- AI音声を悪用した詐欺の仕組みとは

- なぜ今、AI声を使った詐欺が増えている?

- 高齢者や家族が狙われる理由

- いつもの電話が詐欺にすり替わる危険性

- ディープフェイク詐欺との違いを知る

AI音声を悪用した詐欺の仕組みとは

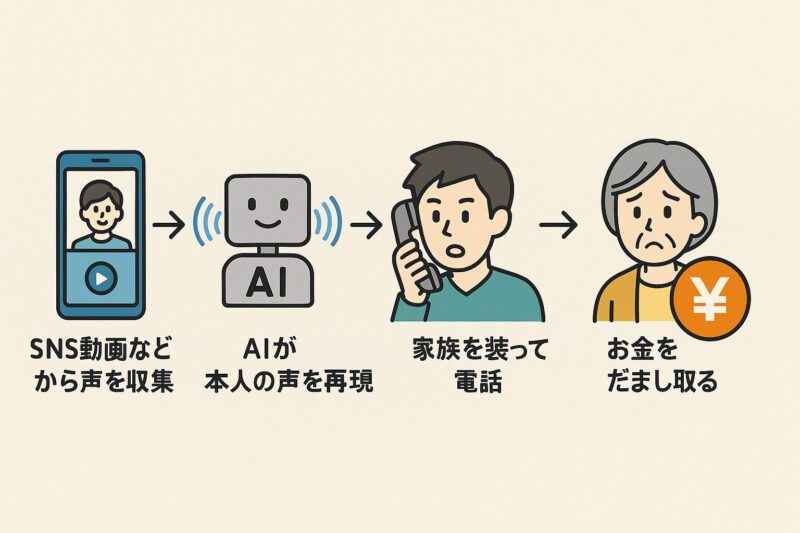

AI音声詐欺とは、AIが本人そっくりの「声」を再現し、それを使って家族や知人になりすまして金銭や個人情報を騙し取る詐欺手口です。

この詐欺では、SNSや動画などから入手した数秒の音声をAIに学習させることで、実在する人物の「本人っぽい話し方」を生成します。犯人はその音声で「携帯が壊れたから連絡先が変わった」「事故にあったからお金がいる」といったセリフを使い、信頼関係を逆手にとって詐欺を仕掛けます。

警視庁は「犯人の声」を警察公式に公開し、詐欺手口への警戒を呼びかけています(出典:警視庁 音声コーナー)

ミオ

ミオまさか声まで作られてしまうなんて…想像以上にハイテクで怖いですよね。

なぜ今、AI声を使った詐欺が増えている?

近年この詐欺が急増しているのは、「AI技術の進化」と「音声データの収集が簡単になったこと」が主な理由です。

今では、無料でも使える音声合成サービスで、たった数秒の音声から本人そっくりの“クローンボイス”が作れるようになっています。そしてSNSや動画投稿が日常化した今、自分や家族の「声」がネット上に出ている機会がとても増えているのです。

独立行政法人情報処理推進機構(IPA)も、2023年に「音声AIの悪用リスク」に言及し、「ディープフェイクやAI音声の技術を使った“なりすまし詐欺”が現実に起きている」と注意を促しています(出典:IPA セキュリティセンター|AIの脅威と活用)。

ミオ

ミオどこかにアップした“自分の声”が、知らないうちに悪用されてるかも…なんて不安になりますよね。

高齢者や家族が狙われる理由

AI音声詐欺では、とくに高齢者が標的になりやすいと言われています。その理由は、「防犯意識の差」「家族関係に対する信頼の高さ」「緊急連絡に弱い」など、心理的な隙をつかれやすいためです。

内閣府が公表している統計によれば、令和5年中の特殊詐欺の被害者のうち、65歳以上が約78%を占めています。年代別では70代以上が合計76%を占めており、特に女性の被害が多いと報告されています(出典:内閣府:令和6年版高齢社会白書(全体版))。

たとえば「孫を装ったAI音声で“事故にあった”と伝え、至急振り込むよう求める」といったケースが多く、本人に確認せずに送金してしまう被害が増えています。

ミオ

ミオ本当に、大事な人ほど信じてしまう…それが逆に落とし穴になるなんて悲しいですよね。

いつもの電話が詐欺にすり替わる危険性

最近では、何気ない1本の電話が“AI音声詐欺”に変わることが現実に起きています。「非通知」「知らない番号」からかかってくる電話で、家族や役所などを装って金銭を要求するパターンが増えています。

消費者庁の消費者安全調査委員会でも、「高齢者が電話での不審なやりとりを信じてしまい、振り込んでしまう事例」が多数報告されています(出典:国民生活センター 消費者トラブル解説集)。

とくに最近は、AI音声によって本物の家族のような声で話されるため、「違和感なく騙されてしまう」点が従来の詐欺と大きく異なります。

出る前に“番号の正体”を3秒チェック——迷ったらこちらも参考に。

ミオ

ミオ本当に、まさか“家族の声”がAIで作られて電話されるなんて…びっくりして言葉が出ませんよね。

ディープフェイク詐欺との違いを知る

ディープフェイク詐欺とAI音声詐欺は、どちらも「なりすまし詐欺」の一種ですが、使われる技術と場面が異なります。

ディープフェイク詐欺は、顔や映像をAIで合成して“本人にそっくりな動画”を作り、それを使って信用を得ようとする手口。一方、AI音声詐欺は、電話や音声通話で「声」だけを偽装して直接金銭をだまし取る点が特徴です。

情報処理推進機構(IPA)は2023年第1四半期のサイバー情報共有レポート(J‑CSIP)で、「メールと電話を合わせたディープフェイク音声+なりすまし電話」の事例を紹介しています。例えば、A社の専務になりすました偽音声が使用され、偽の発信元番号で電話がかかるといった手口です(出典:JIRAN FAMILY 開発が進むディープフェイク対策)。

映像ディープフェイクが広がる仕組みと守り方を整理した関連記事もあわせてどうぞ。

ミオ

ミオこうして並べてみると、どちらも信じてしまいそうな精度で怖いですね…。もう本物か偽物か、自分で見抜く時代なんですね。

「電話だけでなく、SMSやネット経由の複合的な詐欺に親が引っかからないか心配…」

巧妙化する手口をすべて人間の目で見抜くのは限界があります。通話の対策と合わせて、スマホ自体を詐欺の脅威から守る「防具」としてセキュリティソフトを導入しておきましょう。

※世界的な第三者機関でも高く評価されているウイルス対策ソフトです。

AI音声のなりすまし詐欺から身を守る方法

- 不審な電話の見分け方とチェックポイント

- 家族を守るためにできる具体的な対策

- 金融詐欺との関連性と注意点

- 被害に遭ったときの相談先と初動対応

- 家庭でもできる予防策を紹介

- 進化するAI詐欺への備えとこれから

不審な電話の見分け方とチェックポイント

不審な電話にはいくつかの共通点があります。たとえば「非通知や見知らぬ番号からかかってくる」「声に違和感がある」「内容が急すぎる」などが挙げられます。

特にAI音声詐欺では、「会話に感情が乏しい」「言葉のタイミングが不自然」「一方的に話し続ける」といった、AI特有の挙動があることも覚えておきましょう。

国民生活センターでは、「電話で“すぐに振り込んで”と言われたら、一度冷静になって」と注意を促しています(出典:国民生活センター)。

ミオ

ミオこうしたチェックリストを覚えておくだけでも、いざというときの判断が変わりますよ。私も電話は一呼吸置いてから出るようにしています。

家族を守るためにできる具体的な対策

AI詐欺から家族を守るためには、「日常的な情報共有」と「緊急時のルール作り」がとても効果的です。たとえば「困ったときはこの合言葉を言おう」などの“家族ルール”を決めておくことがオススメです。

また、親世代には「自分の声もネットに出る時代」という認識がまだ少ない場合があるため、スマホやSNSに詳しい子世代がフォローしてあげるのも大切です。

IPA(情報処理推進機構)は、「AIなりすまし詐欺への家庭内対策」として、情報リテラシー教育の重要性にも言及しています(出典:IPA)

金融詐欺との関連性と注意点

AI音声詐欺は、金融詐欺と密接な関係があります。というのも、多くの場合、電話の目的は「お金を振り込ませる」ことにあるからです。

消費者庁は、「親族を名乗る人物からの電話で“振込口座”を指定されたら、それは詐欺を疑うべき」と明言しています(出典:消費者庁)。

電話やSMSで“至急の認証コード”を迫られたら一度ストップ。実例ベースの対処はこちら。

また、AIの声により“実在する家族名”や“勤務先”などを巧みに使われることで、被害者は本物だと思い込みやすくなります。これが、通常の金融詐欺よりも判断が難しくなる大きな原因です。

ミオ

ミオ不安に思ったときは、直接本人に連絡して確認するのが一番安全。あせらず、一度深呼吸するクセをつけたいですね。

被害に遭ったときの相談先と初動対応

もし「AI音声詐欺かも?」と感じたら、すぐに行動することが大切です。特に「お金を送ってしまった」「口座番号を伝えてしまった」などの場合は、まずは警察へ相談しましょう。

警察庁では、全国共通の「#9110(警察相談専用電話)」を設けており、身近な相談窓口として利用できます

(出典:警察庁|警察相談専用電話)。

また、金融庁や国民生活センターでも、被害状況に応じてアドバイスを受けることができます。すぐに相談することで、振込停止などの措置が取れる場合もあります。

ミオ

ミオ「どうしよう…」と悩むより、「まず連絡」する方が心が軽くなることって多いですよ。

家庭でもできる予防策を紹介

家庭でできる予防策として効果的なのは、「電話にすぐ出ない」「常に留守番設定にしておく」「留守電の内容を確認してから折り返す」といった“受け身の工夫”です。

さらに、「家族の声をSNSや動画に上げない」「電話の際には本人確認の質問をする」など、発信側としての対策もあります。

警視庁は特殊詐欺への対策として「家族間での防犯意識の共有」「音声録音装置の導入」などを推奨しています。

ミオ

ミオちょっとした工夫で防げるなら、できることから始めてみるのが一番ですね。

進化するAI詐欺への備えとこれから

AI詐欺は、今後さらに進化すると予想されています。音声だけでなく、表情やしぐさまで模倣できる「リアルタイムAIなりすまし」も開発段階に入っており、技術の進歩が詐欺の精度を高めてしまう危険性もあるのです。

これからは、技術に対抗するための「学び」と「備え」が必要な時代。AIを疑うのではなく、“使い方を見極める力”が求められているのかもしれません。

ミオ

ミオ少し怖い未来かもしれませんが、正しく知っておけば、ちゃんと守れるんですよ

総括:AI声詐欺から身を守るために今できること

- AIが本人そっくりの声を生成し家族や知人になりすます詐欺手口

- SNSや動画投稿から得た数秒の音声だけで声の偽造が可能

- 詐欺師は「事故に遭った」「連絡先が変わった」などの理由で金銭を要求

- 特殊詐欺の一種として警察庁も注意喚起している

- 無料の音声合成サービスでも高精度な偽声が作れるようになってきた

- 自分や家族の「声」がネット上に公開される機会が急増している

- 高齢者は防犯意識の差や家族への信頼から詐欺に遭いやすい

- 特殊詐欺の約75%は70歳以上の高齢者が被害にあっている

- 知らない番号や非通知からの電話は詐欺の入り口になることが多い

- AIの声は感情が乏しく会話のテンポが不自然なことがある

- 留守番電話や録音機能の活用が詐欺被害の抑止につながる

- 家族内で合言葉を決めるなど日常的な情報共有が効果的

- AI声詐欺とディープフェイク詐欺は使用する技術と媒体が異なる

- 被害にあったら#9110や消費生活センターなどへ早急に相談する

- AI技術はさらに進化しており今後の詐欺はより巧妙化する可能性が高い

しろ

しろ最後までお読みいただき、ありがとうございました。

あわせて読みたい:家族を守る具体的な防衛策

「親のスマホにセキュリティ対策をしておきたいけれど、どれを選べばいいかわからない」という方は、こちらの比較記事を参考にしてください。